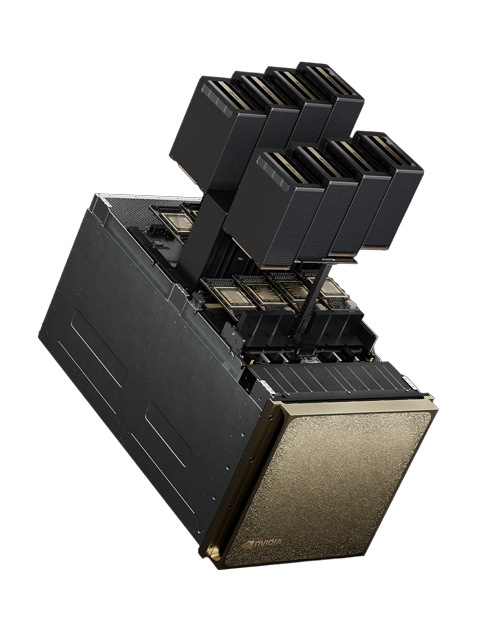

B200

대규모 언어 모델(LLM) 훈련 및 실시간 추론 성능이 획기적으로 향상된 모델

B200 사양

| GPU | 8x NVIDIA Blackwell GPU |

|---|---|

| GPU 메모리 | 총 1,440GB, 64TB/s HBM3e 대역폭 |

| 성능 | FP4 Tensor 코어: 144 PFLOPS | 72 PFLOPS* FP8 Tensor 코어: 72 PFLOPS** |

| NVIDIA NVSwitch | 2개 |

| NVIDIA NVLink 대역폭 | 총 14.4TB/s |

| 전력 소비 | 최대 14.3kW |

| CPU | Intel® Xeon® Platinum 8570 프로세서 2개 총 112개 코어, 2.1GHz(기본), 4GHz(최대 부스트) |

| 시스템 메모리 | 2 TB, 4 TB까지 확장 가능 |

| 네트워킹 | 싱글 포트 NVIDIA ConnectX-7 VPI 8개를 제공하는 OSFP 포트 4개

|

| 관리 네트워크 | 10 Gb/s 온보드 NIC(RJ45 포함) 100 Gb/s 듀얼 포트 이더넷 NIC RJ45가 포함된 호스트 베이스보드 관리 컨트롤러(BMC) |

| 스토리지 | OS: 2× 1.9TB NVMe M.2 내부 스토리지: 8x 3.84 TB NVMe U.2 |

| 소프트웨어 | NVIDIA AI Enterprise – 최적화된 AI 소프트웨어 NVIDIA Mission Control – NVIDIA Run:ai 기술을 활용한 AI 데이터센터 운영 및 조정 NVIDIA DGX OS / Ubuntu – 운영 체제 |

| 랙 장치(RU) | 10 RU |

| 시스템 크기 | 높이: 444mm(17.5인치) 너비: 482.2mm(19.0인치) 길이: 897.1mm(35.3인치) |

| 작동 온도 | 10-35°C (50-90°F) |

| 엔터프라이즈 지원 | 3년간 비즈니스 표준 하드웨어 및 소프트웨어 지원 |

B200 제공 GPUaaS 플랫폼 및 요금제

AWS

AWS에서 제공하는 GPUaaS

요금제

VAT 별도

| 인스턴스 크기 | GPU(NVIDIA B200) | GPU 메모리(GB) | vCPU | GPU 피어 투 피어(GB/s) | 인스턴스 스토리지(TB) | 네트워크 대역폭(Gbps) | EBS 대역폭(Gbps) | 요금 |

|---|---|---|---|---|---|---|---|---|

| P6-b200.48xlarge | 8 | 1440 HBM3e | 192 | 1800 | 8 x 3.84 NVMe SSD | 8 x 400 | 100 | 별도 문의 |

Google Cloud

Google Cloud에서 제공하는 GPUaaS

요금제

VAT 별도

| 머신 유형 | vCPU 수1 | 인스턴스 메모리(GB) | 연결된 로컬 SSD(GiB) | 물리적 NIC 수 | 최대 네트워크 대역폭(Gbps)2 | GPU 수 | GPU 메모리3 (GB HBM3e) |

요금 |

|---|---|---|---|---|---|---|---|---|

a4-highgpu-8g |

224 | 3,968 | 12,000 | 10 | 3,600 | 8 | 1,440 | 별도 문의 |

NHN CLOUD

NHN CLOUD에서 제공하는 GPUaaS

요금제

VAT 별도

| B200 Server(GPU 8장) | 별도 문의 |

|---|